突发-暴击专家模型!Meta最新多模态大模型ImageBind已开源

新智元报道

编辑:桃子 拉燕

【新智元导读】Meta简直杀疯了!多模态「千脑智能」ImageBind来了,能够像人的感官一样,从多种维度理解世界。

前段时间,带着开源LLaMA杀疯的Meta,让谷歌都后背发凉。

今天,Meta又丢下了重量级炸弹:

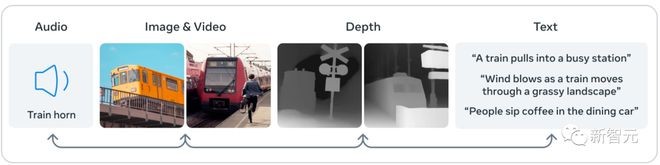

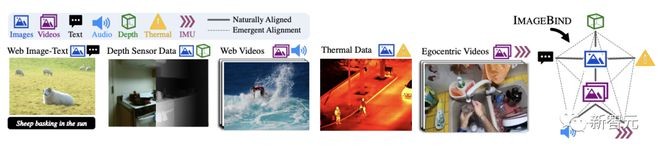

拥有「多种感官」的多模态AI模型ImageBind,能够将文本、音频、视觉、热量(红外),还有IMU数据,嵌入到一个向量空间中。

这么说吧,ImageBind就像「千脑智能」一样,能够调动6种不同的感知区域进行联动交流。

再直观点,能够听声音「脑补」,给它一个企鹅的音频,直接就能出图。看来,文生图要被颠覆了......

甚至,给一个鸽子图,外加一个摩托音频,能够检索出一张摩托和鸽子的图片。

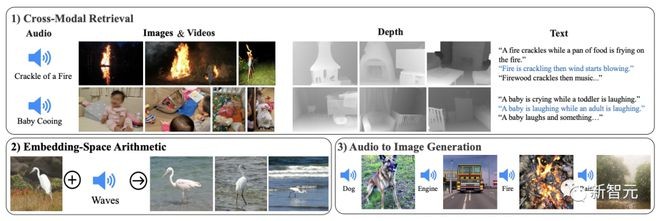

这还不算啥,ImageBind还可以进行跨模态检索,如火车喇叭音频,文本、深度、图片&视频。

正如论文所说「One Embedding Space To Bind Them All」,Meta这次可是发力要搞模型元宇宙。

把不同模态数据串联在一个嵌入空间(Embedding Space),让其从多维度理解世界。

论文地址:https://dl.fbaipublicfiles.com/imagebind/imagebind_final.pdf

未来,不仅如此,这个「千脑智能」还将引入更多模态增强对世界感知,比如如触觉、语音、嗅觉和大脑fMRI信号。

Meta这一举,几乎给OpenAI来了重磅一击。

最最重要的是,ImageBind项目已经在GitHub上开源了!不过Meta明确规定是不能商用的。

这个汇集各种感官能力的ImageBind,究竟有多强?

动手实操

Meta开放了模型演示,具体包括(如下):

使用图像检索音频

以图像或视频作为输入,即时生成给出音频。比如选择一张恶犬的图片,就能够检索到狗吠的音频。

听着让人瑟瑟发抖......

使用音频检索图像

通过一个音频片段,给出一张对应的图。听着喇叭鸣声,轨道咔哒咔哒地声音,火车来了

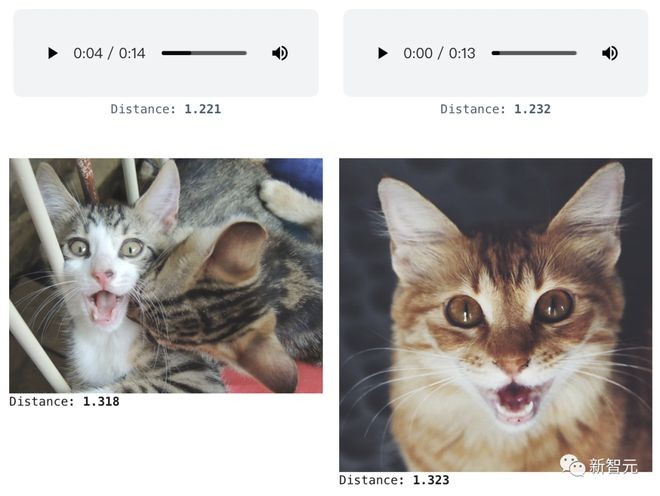

使用文本来检索图像和音频

选择下面的一个文本提示,ImageBind将检索与该特定文本相关的一系列图像和音频片段。

就选择个「喵喵叫」吧。还给了一张秀恩爱的猫咪...

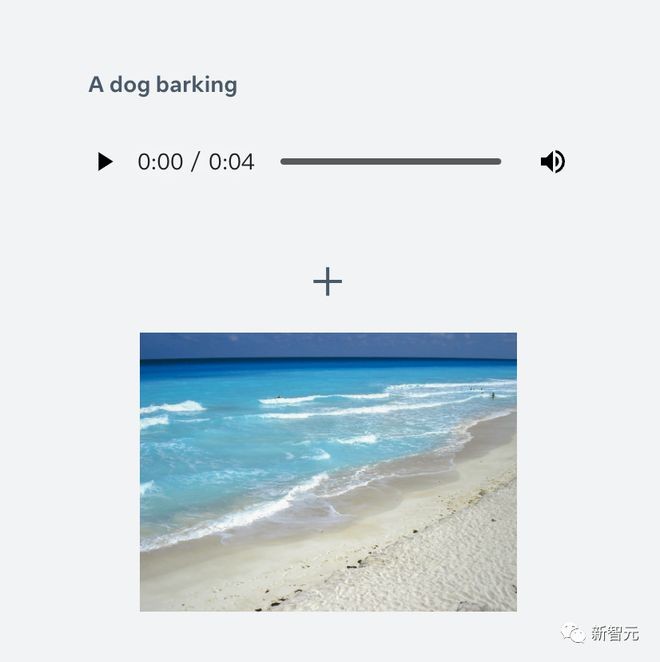

使用音频+图像来检索相关图像

给一个狗叫声,外加一张阳光沙滩。

ImageBind可以在几分钟内检索出相关图像。

以后上传一个视频/音频,就能推荐一些素材,视频编辑岂不是人人都能玩转了?

使用音频来生成一个图像

在这里想要实现音频生图像,ImageBind需要和其他模型一起结合用,比如 DALL-E 2等生成模型。

来个下雨哗啦啦的声音,身在其中的意境图就来了。

ImageBind就先炫到这里了。接下来看看,它究竟是如何实现如此强大的能力。

类人ImageBind理解世界

ImageBind是一个像人类一样结合不同感官的新AI模型。

它可以实现跨6种模态,包括图像、视频、音频、深度、热量和空间运动,进行检索。

把不同的模式嵌入叠加,可以自然地构造它们的语义。比如,ImageBind可以与DALL-E 2解码器和CLIP文本一起嵌入,生成音频到图像的映射。

其中,用上了Meta近来开源的一系列AI模型,比如DINOv2,SAM,Animated Drawings。

这样视觉模型有了,分割模型有了,生成动画的能力也有了。

而ImageBind则是对这些模型的一个补充,目的是给不同模式的学习提供一个统一的特征空间。

在未来,ImageBind可以利用DINOv2的强大视觉特征来进一步提高其能力。

ImageBind通过利用大型视觉语言模型,和零样本能力扩展到新的模态来规避这一挑战。

只是通过使用它们与图像(视频、音频和图像、深度数据)的自然配对来学习单个联合嵌入空间。

对于四个其他的模态(音频,深度,热量和IMU) ,用到了自然配对的自监督数据。

由于网络上存在大量的图像和现有的文本,训练图像-文本模型得到了广泛的研究。

ImageBind使用图像的绑定特性,这需要图像与各种模态共同出现,可以作为连接它们的桥梁。

例如使用网络数据将文本与图像连接起来,或者使用从带有 IMU 传感器的可穿戴摄像机捕捉到的视频数据将动作与视频连接起来。

Meta称,图像配对数据足以将这六种模态绑定在一起。ImageBind可以更全面地解释内容,允许不同的模式彼此「交谈」。

暴击专家模型

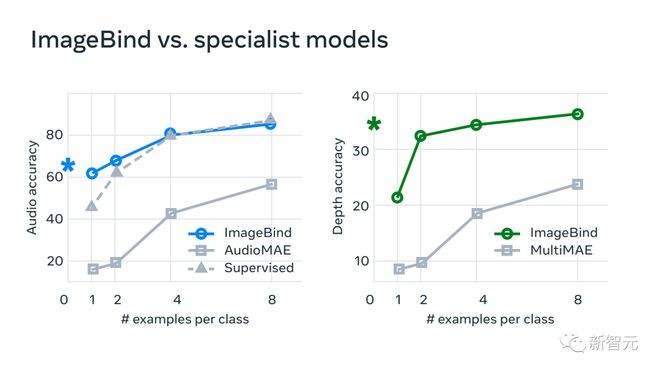

Meta的研究人员表示,图像对齐和自监督的学习表明,仅需少量样本的训练就可以提升Meta的模型性能。

Meta的模型具有小模型所不具备的出色能力,这些性能通常只会在大模型中才会呈现。

比如:音频匹配图片、判断照片中的场景深度等等。

Meta的研究表明,ImageBind的缩放行为会随着图像编码器的性能提升而提升。换句话说,视觉模型越强,ImageBind对齐不同模态的能力就越强。

训练这种模型所带来的收益不仅局限于计算机视觉本身。

在Meta进行的研究中,研究人员使用了ImageBind的音频和深度编码器,并将其与之前在零样本检索以及音频和深度分类任务中的工作进行了比较。

音频和深度编码器是一种可以将音频和深度信息转换为特征向量的技术,通常会用于多模态数据集的建模和分析。

而零样本检索是指在没有任何标签信息的情况下,从数据集中检索出与查询相关的数据。

这种技术在图像、文本、语音等领域中都有应用。音频和深度分类任务是指将音频和深度信息分为不同类别的任务,通常用于识别声音或分析深度图像。

研究人员发现,ImageBind的特征可以用于少样本音频和深度分类任务,并且可以胜过专门针对这些模态的先前方法。

比方说,ImageBind在少于四个样本分类的top-1准确率上,要比Meta的自监督AudioMAE模型和在音频分类fine-tune上的监督AudioMAE模型提高了约40%的准确率。

ImageBind还在跨模态的新兴零样本识别任务上取得了新的最先进性能,甚至优于为该模态训练的最近模型来识别概念。

未来用在哪?

从上面的演示可以看到,ImageBind具有使用多种输入查询模式和在其他模式下检索输出的能力,为创作者展示了新的可能性。

近来,Meta看似全力以赴搞AI,其实全是元宇宙。

比如,通过结合3D和IMU传感器,能够设计,甚至体验身临其境的虚拟世界。

ImageBind还提供了一种丰富的方式来探索记忆,利用文本、音频和图像的组合检索图片、视频、音频或文本信息。

想象一下,有人拍摄了一段海上日落的视频,用上ImageBind就可以一秒添加完美契合的音频来让整个画面更加的酷炫。

而输入一张虎斑狮子狗的图片,ImageBind也可以一键生成有关狗的文章或该图像的深度模型。

用户甚至可以基于音频对图像中的对象进行分割和识别。有了这个能力,人们能就可以通过将静态图像与音频提示相结合来创建动画。

比方说,一个创作者可以将一张图片与闹钟和公鸡啼叫相结合,并使用鸡叫的音频提示来分割公鸡或闹钟的声音,然后进一步分割时钟,并将两个动画整合成一个视频序列。

Meta的研究人员表示,关于多模态学习仍有很多需要探索的地方。

目前,整个AI社区还没能有效地量化仅出现在较大模型中的扩展行为,并进一步理解它们的应用。

Meta希望,AI开发者社区能够探索ImageBind,以及配套发表的论文,以找到评估视觉模型和引领新应用的新途径。

网友狂欢

当然了,自家实验室这么重磅的研究,LeCun也少不了宣传一波。

英伟达科学家Jim Fan点评道:

自LLaMA以来,Meta就在开源领域大放异彩。

ImageBind:Meta最新的多模态嵌入,不仅涵盖了常规数据类型(文本、图像、音频),还包括深度、热量(红外)和IMU信号!

OpenAI Embedding是AI驱动搜索和长期记忆的基础。ImageBind是Meta的Embedding API,用于丰富的多媒体搜索、虚拟现实甚至机器人技术。元宇宙将建立在向量的基础上。

通过对齐6种模态,你可以实现一些仅靠文本的GPT-4无法实现的花式功能:

-跨模态检索:将其视为多媒体谷歌搜索

-嵌入空间算术:无缝地组合不同的数据格式

-生成:通过扩散将任何模态映射到其他任何模态

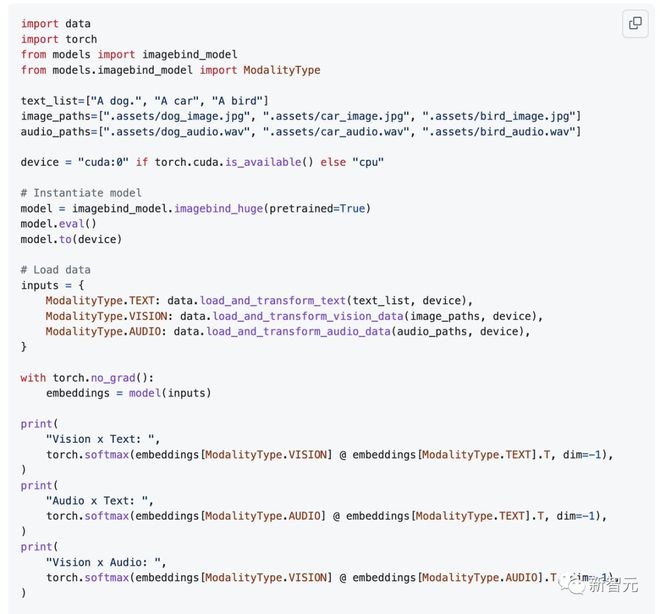

顺便提一句,你可以在大约30行的python代码中使用这个多模态Embedding API。

Meta跃跃欲试地开放AI,微软却说「不好意思,我们正在开放多模态感官/形式AI」。

ImageBind的诞生就是为了模拟人类感知。

ImageBind甚至优于之前,为某一特定模态单独训练的专家模型。有了它,智能体现在可以理解照片中的物体、声音、三维形状,以及它们如何移动。简言之,就像我们人类一样!

嵌入一直以来非常有用。随着GPT迅速蹿红,相信更多的人已经从它那里获得了令人难以置信的价值。IMAGEBIND展示了嵌入的力量,甚至在许多模态上得到了极大的增强。

有了ImageBind,感觉万物皆向量,还是相同的向量空间

SAM发布后,许多人惊呼CV不存在了。网友直接点名,Meta能给我们留点不?

不像某些人(OpenAI),Meta是开源极大推动者。

ImageBind面世,贾维斯也不远了。

参考资料:

https://imagebind.metademolab.com/

https://dl.fbaipublicfiles.com/imagebind/imagebind_final.pdf

https://ai.facebook.com/blog/imagebind-six-modalities-binding-ai/

https://github.com/facebookresearch/ImageBind